面向人脸识别的高质量类中心学习方法研究

人脸识别的高质量类中心学习方法研究

随着计算机视觉与人工智能的发展,人脸识别被广泛地应用到人们生活的各个方面,如人脸认证、人脸支付、监控视频分析以及嫌犯追逃等。以Softmax损失函数为基础的人脸识别算法极大地改善了人脸识别性能。这些识别算法致力于为每一个人脸类别学到一个类中心,并使人脸样本能够紧密围绕在对应类别类中心周围,同时使不同类中心之间尽可能地保持足够间隔。然而当前方法平等对待每一个样本,因此当训练集中某一人脸样本中低质量样本占多数的时候,在损失函数的约束下,类中心将会靠近这些低质量的样本,使得类中心的表示能力大大降低,这将削弱复杂场景下的人脸识别性能。

为了解决这一问题,我们提出了一个面向人脸识别的高质量类中心学习方法。其主要包含两个主要的损失,一个是质量感知的分类损失(LID),另一个是高质量感知的类中心损失(LC)。在LID中,我们对不同质量的样本赋予了不同的scale和margin值,给高质量样本更大的scale值可以引导类中心靠近高质量样本,为低质量样本赋予更大的margin可以进一步促使低质量样本紧紧围绕在类中心周围。最终学到的类中心能够靠近高质量样本,从而改善类中心的特征表示能力,提升模型性能。LC则是通过直接构造类中心与高质量样本间的L2损失,进一步引导类中心靠近高质量样本。LID和LC的结合可以有效地引导类中心靠近高质量样本,使类中心包含更多具有人物表示特征的关键信息,从而提升特征提取模型的特征提取能力。

该成果“HQ2CL: a High-Quality Class Center Learning System for Deep Face Recognition”已于2022年发表在IEEE Transactions on Image Processing (TIP)期刊的31卷上。TIP是计算机学会(CCF)计算机图形学与多媒体方向的A类期刊,也是人工智能领域的顶级期刊,当前的影响因子为11.041。

论文链接:

https://ieeexplore.ieee.org/document/9852153

背景与动机

近年来,作为典型的分类损失函数,Softmax与神经网络最后输出层紧密联系在一起,并被广泛地应用于各种分类任务,并取得了良好的分类效果。对于具有C个类别的分类任务,其Softmax损失形式可以表示如下:

其中,N为一个mini-batch的样本数,xi是其中第i个样本的特征,yi则是xi对应的类别。显然,样本特征在经过线性变换(也即是网络全连接)之后得到了C个类别的分数,对应的第yi个类别的分数与总类别分数之和的比值,即为该样本正确分类的概率。这也是Softmax损失的本质所在。不过,Softmax损失只是将样本特征区分开,并不会约束样本特征之间的分类间隔。因此,在类别和样本都更多的人脸识别任务中,Softmax损失约束能力就显得尤为不足。

为了将Softmax用于人脸识别,研究人员对其形式做了很多改进。如,将线性变换的偏移bj置为0;将样本特征xi和线性变换权重wj进行L2正则化,也即是将xi和wj都变成了单位向量(模长为1)。因此,

其中

因此,在该式中,样本特征与线性变换权重之间夹角的余弦值就直接表示了样本所属类别的分数。在此基础上,研究人员进一步增加了一个角度间隔m去缩小样本特征与其所属类别权重之间的夹角,从而进一步提升模型的类间可区分度以及类内紧奏性。同时,为了确保损失的收敛性,研究人员使用了一个尺度s对夹角余弦值进行缩放。基于此,新的损失函数可以表示为:

在该损失的约束下,训练得到的人脸识别性能大幅度提升,模型特征表示能力更强。然而,当前训练集中的样本质量参差不齐,这会对上述约束产生严重干扰。为了改善模型对低质量样本(如大角度、低分辨率、模糊等)的特征表示能力,训练集中往往包含了大量低质量样本,但当前方法平等对待训练集中的每一个样本,当样本中低质量样本过多时,为了更好地对训练集进行拟合,类中心会从这些占据大多数的低质量样本中学习人物的特征表示信息,而忽视了高质量样本中更能表示人物身份属性的关键特征信息,从而导致类中心质量降低,干扰特征提取模型的学习训练。当使用该特征提取模型对复杂场景下人脸进行识别时,往往得不到预期的识别效果。因此,如何缓解因训练集中样本质量差异对模型性能产生的伤害,改善复杂场景下人脸识别性能,仍是一个亟待解决的关键问题。

设计与实现

当我们训练一个人脸识别模型时,实际就是在迭代一个骨干网络

图1 面向人脸识别的高质量类中心学习系统

如上图1所示,为了改善类中心质量,我们首先基于样本质量评估模型以及基于现有方法训练得到的样本特征与类中心之间的相似度来计算每一个样本的质量,然后根据质量值将每一个类别中的所有样本划分为高质量和低质量两个部分,具体样本质量评估方法可以参考我们的论文。正如先前提到的那样,当前方法平等对待每一个训练样本,每一个样本拥有相同的尺度值s和角度间隔m。研究表明s的大小可以有效控制样本在训练中的重要性,而角度间隔m则控制着该样本与类中心之间的距离。因此,为了实现我们改善类中心质量的目的,在构造身份损失LID时,我们为两个不同质量的样本赋予不同的尺度值s和不同的角度间隔m。赋予高质量样本更大的s值可以增加高质量样本在训练中的作用,引导类中心靠近高质量样本;而为低质量样本赋予更大的m可以进一步促使低质量样本更加紧密地围绕在类中心周围。最终学到的类中心能够靠近那些高质量样本,低质量样本则在分类间隔m的约束下更加紧密的靠近类中心,从而改善类中心的特征表示能力,提升模型的特征表示能力,在面对新的人物或样本时,也能够更好地保持模型识别性能。

我们也进一步提出了一个高质量类中心损失LC,通过直接构造类中心与高质量样本间的L2损失,进一步引导类中心靠近高质量样本,改善类中心质量。最后,我们将LC与身份损失LID结合在一起,在二者的共同约束下,类中心将从高质量样本学习借鉴到更多的人物身份属性关键特征,从而进一步帮助改善骨干网络的特征表征能力,提升模型识别性能。

实验评估

图3 高质量样本与低质量样本间相似度分布对比

为了验证提出方法的有效性,如图2所示,我们首先对比了提出方法与Arcface方法在类中心与高质量样本间的特征相似度分布情况,可以看出,提出的方法确实使得类中心更加靠近高质量样本。如图3所示,我们进一步对比了高质量样本与低质量样本间的相似度分布,提出的方法也显著地拉近了低质量与高质量样本间的距离。上述实验结果表明,提出的方法可以有效地改善类中心的质量,这些类中心可以更加靠近高质量样本,低质量样本也会更加紧凑地围绕在类中心周围。

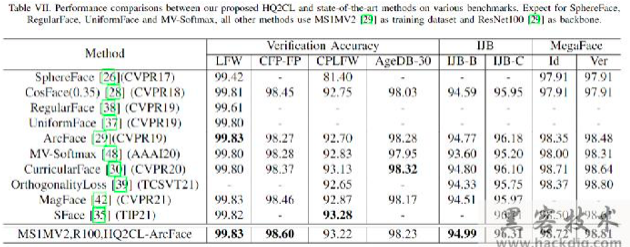

图4 提出方法与现有方法对比结果

如图4所示,我们使用多个人脸识别算法作为对比,并在多个人脸数据集上,对提出的高质量类中心方法进行评估验证。实验结果表明,与现有的人脸识别方法相比,在多种不同基准数据集上,提出的方法都得到了最佳结果,特别是在大规模人脸基准数据集IJB和MegaFace上。

详细内容请参见:

Xianwei Lv, Chen Yu, Hai Jin and Kai Liu, "HQ2CL: A High-Quality Class Center Learning System for Deep Face Recognition," in IEEE Transactions on Image Processing, vol. 31, pp. 5359-5370, 2022, doi: 10.1109/TIP.2022.3195638.

通讯地址:北京市海淀区海淀南路甲21号中关村知识产权大厦A座2层206、207室 邮政编码:100080

电话:010-62565314 刘莉 京ICP证16064523号-2 版权所有:北京软件和信息服务业协会

技术支持:中科服 内容支持:鑫网安